Сервис проката электросамокатов «Lime» запустит в Израиле функцию с искусственным интеллектом для контроля парковки средств передвижения.

Приложение сможет немедленно определить, припаркован ли транспорт в соответствии с городскими постановлениями, предупредить водителя и предложить ближайшую легальную альтернативу. Функция также взимает с пользователя автоматический штраф, если скутер остается припаркованным незаконно.

Израиль станет первой страной, где Lime опробует это нововведение. Функция начнет работать в ближайшие недели в Тель-Авиве и Рамат-Гане. Позже компания планирует расширить ее по всей стране и по всему миру.

Искусственный Интеллект всё больше и больше внедряется в нашу повседневную жизнь повсеместно.

Хорошо это или плохо для нас, -попробуем разобраться в продолжении этой статьи.

«Сегодня — самокаты, завтра автомобили, послезавтра- безработные, бывшие заключённые, тяжело больные, резиденты псих.лечебниц и закрытых воспитательных и реабилитационных учереждений, школьники,…и тд. ?

Цель — Контроль и Порядок…»

[цитата]

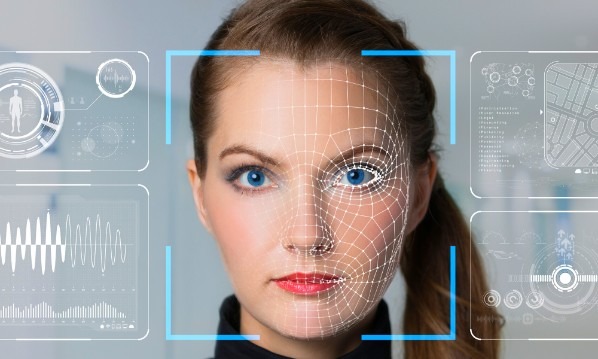

Рассмотрим для примера системы слежения и распознавания лиц с участием машинного обучения и ИИ:

Американская некоммерческая организация Mitre Corp. разработала технологию определения имени человека по чертам его лица.

В ее основе лежит работа ученых из Еврейского университета в Иерусалиме, которые обучили алгоритм определять имя человека из двух представленных вариантов.

Разработанная ими модель правильно угадывала имя в 59% случаев, что выше 50%, которые можно было бы ожидать от случайных догадок. Однако сотрудники Mitre усовершенствовали технологию и повысили точность угадывания из двух возможных вариантов до 80,5%.

Они предполагают, что их алгоритм можно использовать и в обратную сторону: выбирать наиболее подходящие фотографии людей под заданное имя.

Журналисты также выяснили, что единственным клиентом Mitre является правительство США.

Ранее они разрабатывали технологии распознавания лиц для ФБР.

За последние несколько лет компания получила до $2м.

Американцы лишились пособия по безработице из-за ошибки ИИ в системе распознавания лиц…

Об этом пишет Motherboard.

По данным СМИ, получатели пособий из многих штатов неоднократно жаловались, что система не смогла правильно их идентифицировать. Им было трудно связаться с представителями компании для решения проблемы.

Генеральный директор ID.me Блейк Холл заявил, что сбои в биометрической идентификации являются проблемой для людей, которые неправильно используют подсказки сервиса во время прохождения проверки, а не для технологий.

По его словам, алгоритмы для сопоставления лиц работают с эффективностью приблизительно 99,9%.

«Фактически нет никакой связи между оттенком кожи и отказами системы сопоставления лиц в проверке “один к одному”», — подчеркнул Холл, опираясь на проведенный компанией регрессионный анализ.

Он добавил, что им не было известно о людях, которые не могли подтвердить свою личность с помощью его программного обеспечения.

«Время ожидания сеанса видеочата в реальном времени сейчас составляет менее пяти минут, а на протяжении всей недели оно не превышало 30 минут», — отметил Холл.

Служба проверки личности ID.me сверяет биометрические данные с официальными документами для снижения уровня мошенничества с пособиями по безработице. Ее используют власти 21-го штата США.

А также местные департаменты полиции в США совместно с ФБР выявляют нападающих на здание Капитолия с помощью технологий распознавания лиц.

Американский конгрессмен заявил, что компания XRVision, предоставляющая услуги по распознаванию лиц, обнаружила членов «Антифа» среди толпы, атаковавшей здание Капитолия. В компании информацию опровергли и подчеркнули, что их технологии идентифицировали неонацистов и приверженцев движения QAnon.

Полиция Нью-Йорка имеет возможность отслеживать людей и распознавать их лица в Манхэттене, Бруклине и Бронксе с помощью 15 280 камер видеонаблюдения, говорится в расследовании Amnesty International.

Правозащитники составили интерактивную карту со всеми известными местоположениями устройств фиксации на перекрестках трех крупнейших городских районов.

С помощью собранной информации правозащитники попытались смоделировать поле зрения нью-йоркской сети видеонаблюдения и выяснили, что комбинация полицейских, общественных и частных камер способна отслеживать лица на расстоянии до 200 метров.

Они также сообщили, что направляли в полицию Нью-Йорка запросы с просьбой предоставить дополнительные сведения о масштабах использования распознавания лиц, однако все они были отклонены.

Исследователи разработали сервис, который по фотографии пользователя определяет, насколько он(пользователь) «нормальный».

Он использует сразу несколько алгоритмов, которые пытаются определить привлекательность, возраст, пол, индекс массы тела и оставшиеся годы жизни человека по чертам его лица.

Таким способом разработчики хотят продемонстрировать, как компании применяют распознавание лиц для расширенной аналитики и как алгоритмы судят о людях по их внешности.

Страховая компания Lemonade извинилась за некорректное толкование собственной ИИ-системы, которая с помощью распознавания лиц проверяет пользователей на предмет мошенничества.

До этого компания похвасталась, что ее алгоритм улавливает более 1000 «невербальных» сигналов, которые «традиционные страховщики» не могут выявить.

Пользователи и эксперты обвинили технологию в потенциальной предвзятости. Они отметили, что система может неправильно истолковать выражение лица человека в шоковом состоянии и заподозрить его в мошенничестве.

В компании заявили, что они не используют алгоритмы распознавания эмоций и никогда не поручали ИИ принимать решения об отклонении заявлений. Однако в прошлом году перед IPO в Lemonade говорили, что их ИИ обрабатывает треть всех случаев и принимает решение о выплате или отклонении претензии без вмешательства человека.

Американский банк использует компьютерное зрение для отпугивания бездомных от банкоматов.

Если бездомный попытается установить палатку в зоне drive-through, система автоматически включит аудиозапись и «вежливо» просит его покинуть территорию.

Другие крупные банки, несмотря на негативную реакцию общественности, активно разворачивают компьютерное зрение.

Например, JPMorgan с 2019 года использует технологию для анализа архивных материалов о поведении клиентов, в то время как Wells Fargo — для предотвращения мошенничества.

В одной из подмосковных школ протестируют систему искусственного интеллекта для наблюдения за безопасностью детей и мониторинга состояния инфраструктуры.

Видеокамеры с ИИ научат распознавать нетипичное поведение ребенка, например бег по коридору или катание по перилам. В таких случаях система уведомит ответственных сотрудников школы чтобы те предприняли необходимые меры.

По словам разработчиков, все технологии, использованные в конструировании, — российские.

Они также подчеркнули, что система не принимает решений, а предназначена для информирования о возможных происшествиях.

Система распознавания лиц в московском метро нашла более 600 человек, находящихся в федеральном розыске.

При этом говорится, что в городе снизилось число таких преступлений, как угоны автомобилей и квартирные кражи, и что всё это это произошло благодаря большому количеству камер видеонаблюдения и системе распознавания лиц.

Китай протестировал на уйгурах искусственный интеллект для обнаружения эмоций.

Об этом рассказал программист-инженер, который участвовал в разворачивании системы.

По его словам, видеокамеры разместили на расстоянии трех метров от объектов съемки.

Испытуемых поместили в специальные кресла, где их запястья и лодыжки зафиксировали металлическими ограничителями, рассказал очевидец.

Инженер продемонстрировал журналистам фотографии задержанных уйгуров и отметил, что система распознавания предназначена для «предварительного суда без каких-либо достоверных доказательств».

Посольство Китая в Лондоне не ответило на вопросы журналистов об использовании в провинции ПО для распознавания эмоций и заявило, что соблюдает права меньшинств в регионе.

Власти Индии задействовали 350 камер с искусственным интеллектом для поиска нарушителей карантинных ограничений во время празднования Кумбха-Мелы — масштабного религиозного паломничества, собирающего десятки миллионов людей раз в 12 лет поочередно в четырех святых местах страны.

В течение первых нескольких дней фестиваля, который официально начался 1 апреля, правоохранители поймали 350 человек без масок, а в течение всего периода празднования было наложено 1 500 штрафов за нарушение норм безопасности во время фейкдемии.

Однако камер с ИИ может быть недостаточно для сдерживания популярного «инфо-коронавируса».

Полицейские заявили, что им будет сложно выявлять нарушителей в дни Шахи Снан, когда миллионы людей соберутся на берегу Ганга, чтобы искупаться в священной реке.

Сотрудники почти двух тысяч государственных учреждений в США, включая полицейские управления и государственные школы, использовали Clearview AI без разрешения от своего начальства.

По данным Buzzfeed News , они задействовали распознавание лиц не только для поиска участников недавних протестов и мелких преступников, но и своих друзей и членов семьи. Репортеры связались с руководителями ряда ведомств.

Как оказалось, многие из них не знали, что их сотрудники имеют доступ к системе.

Это стало известно благодаря анонимному источнику, который передал журналистам базу данных поисковых запросов с указанием того, какие агентства имели доступ к платформе.

На основе этой информации журналисты создали страницу, где каждый желающий может проверить, какие ведомства использовали распознавание лиц спорной платформы.

В Clearview AI отказались подтвердить достоверность информации и не ответили на вопросы об утечке.

Американская компания Ambarella представила чип для камер видеонаблюдения для съемки в 4К, — распознавания лиц и мониторинга толпы.

Производители заявили, что искусственный интеллект, развернутый на микросхеме, обрабатывает видеопоток в четыре раза быстрее, чем другие процессоры компании. При этом инженеры повысили энергоэффективность чипа на 30%.

Они добавили, что камеры с процессорами Ambarella пригодятся для мониторинга трафика на дорогах, контроля скорости, поиска без вести пропавших людей и угнанных машин.

Кроме этого, компании могут использовать их для анализа работы персонала и контроля выкладки товаров.

О сроках появления новинки на рынке в Ambarella не сообщили. Компании могут оставить заявку на сайте для участия в закрытом тестировании чипов, которое начнется в октябре 2021 года.

Исследователи разработали алгоритм распознавание лиц для определения политических предпочтений человека.

Исследователи Стэнфордского университета создали алгоритм машинного обучения, который по фотографии человека сможет определить его политические симпатии. В результатах исследования утверждается, что точность работы алгоритма может достигать 72%.

Разработчики взяли выборку лиц чуть более миллиона человек с неназванного «популярного сайта знакомств».

Во всех случаях – либо где-то на этом сайте знакомств, либо где-то в своем профиле в Facebook – эти пользователи указали, что они «консервативны» или «либеральны».

После этого разработчики обучили модель распознавать ключевые точки на лицах и выявлять закономерности для последующего определения политических предпочтений.

Однако, как отмечает VentureBeat, все исследование основано на псевдонаучной теории «физиогномики».

Психологи уже много лет говорят, что алгоритмы, определяющие, может ли кто-то с большей вероятностью оказаться грабителем банка, политологом или республиканцем, на основе черт лица на самом деле работают не намного точнее случайных предположений.

Ранее эта же группа ученых в 2017 году разработала алгоритм, который, по их словам, мог определить сексуальную ориентацию человека по чертам лица на фотографии.

Эксперты также раскритиковали результаты этого исследования.

Financial Times сняли короткометражный фильм — «Мы знаем, что вы сделали во время локдауна».

В нем авторы затронули тотальную слежку IT-гигантов за пользователями, их негласное сотрудничество с правительством, непрозрачность ИИ-алгоритмов и невозможность скрыться от отслеживания.

В центре сюжета оказалась девушка, которую пригласили на беседу в технологическую компанию, чтобы отследить возможный источник распространения модного «инфо-коронавируса».

Сперва аналитик рассказывает героине всю информацию, которую они собрали на нее с помощью цифрового следа, а затем задает массу личных вопросов.

С помощью этой 20-минутной сцены допроса журналисты попытались продемонстрировать тонкую грань между необходимостью отслеживания данных якобы для борьбы с фейкдемией и правом на неприкосновенность частной жизни.

На Netflix вышел документальный фильм «Coded Bias», сюжет которого сфокусирован вокруг предвзятости алгоритмов распознавания лиц.

Режиссер ленты Шалини Кантайя исследовала, как алгоритмы машинного обучения могут усилить существующее в обществе классовое, гендерное и расовое неравенство. Большинство центральных персонажей фильма — женщины и цветные люди, к которым алгоритмы часто относятся предвзято. Помимо историй американцев, авторы фильма рассказывают о похожих проблемах жителей Лондона — самого контролируемого города Европы, а также Китая, система социального кредита которого известна во всем мире.

Но есть и хорошие новости по теме Распознования лиц с помощью ИИ.

К примеру, Bosch представила нам свою систему контроля состояния водителя.

Засыпание, снижение концентрации, не пристегнутый ремень безопасности – многие события, происходящие внутри автомобиля, могут иметь далеко идущие последствия.

Для предотвращения критических ситуаций при вождении и возможных несчастных случаев планируется интегрировать в автомобили датчики, которые будут наблюдать за салоном и контролировать состояние водителя и других пассажиров.

Разработанная Bosch система может быть запущена в производство в 2022 году.

К этому времени в планах Евросоюза внести такие технологи безопасности, как система предупреждения о снижении концентрации и засыпании, в перечень стандартного оснащения для всех новых автомобилей.

По прогнозам Комиссии ЕС, за период до 2038 года благодаря новым требованиям к оснащению автомобилей средствами активной безопасности, около 25 000 жизней могут быть спасены, и не менее 140 000 тяжелых травм предотвращены.

Средства слежения за состоянием водителя и пассажиров также станут шагом к решению глобальной задачи создания системы автоматизированного вождения.

Если в процессе движения происходит передача управления и ответственности за вождение от автопилота водителю, система автоматического вождения должна удостовериться, что водитель в момент передачи не спит, не читает газету или не отправляет электронную почту.

Компания Bosch разработала систему контроля, которая распознает признаки усталости водителя, предупреждает об опасности и оказывает помощь в управлении. Встроенная в руль камера направлена на лицо водителя, а программное обеспечение распознает положение век, и реагирует, если человек закрывает глаза. Реакция предусмотрена и на тот случай, когда водитель отвлекся от дороги и повернул голову к пассажирам на переднем или заднем сиденье. Благодаря ИИ система делает выводы из полученной информации: она может предупредить об опасности невнимательного водителя, порекомендовать сделать остановку для отдыха, а, в некоторых случаях, может даже снизить скорость движения: точная реакция может зависеть от настроек, выбранных автопроизводителем, и законодательных требований в части правил дорожного движения в регионе.

Планируется, что Европейская программа тестирования новых автомобилей (NCAP) будет учитывать их в рейтинге безопасности транспортных средств с 2025 года. Полученная при мониторинге информация обрабатывается только программным обеспечением, установленным в самом автомобиле, не хранится и не передается третьим лицам.

Кроме того, данная система следит не только за водителем, но и за пассажирами. Для этого камера, установленная над или под зеркалом заднего вида, контролирует весь салон.

Система способна следить за тем, пристегнуты ли дети или взрослые пассажиры задних рядов ремнями безопасности, и предупреждает водителя, если видит, что ремни не задействованы.

Если кто-то из сидящих сзади слишком сильно наклонился вперед, сел полубоком или положил ноги на сиденье, подушки безопасности и натяжитель ремня не смогут должным образом защитить человека в случае аварии.

Камера слежения будет определять положение тела пассажира, и контролировать параметры срабатывания систем пассивной безопасности так, чтобы обеспечить наилучшую защиту.

Система также предотвратит срабатывание подушки безопасности, если сиденье пассажира занято детским креслом.

В дополнение ко всему, камера наблюдения системы позволяет определить, кто собирается вести машину, и отрегулировать зеркало заднего вида, положение сидения, высоту рулевого колеса и параметры информационно-развлекательной системы в соответствии с личными предпочтениями водителя. Также камеру можно задействовать для управления настройками и проигрыванием мультимедиа с помощью жестов или взгляда.

Сегодня существуют множество проектов которые разрабатывают системы слежения, контроля и мониторинга с помощью ИИ.

Поэтому есть и те, кто активно противостоят этому, открыто заявляя что это прямое нарушение прав и свобод человека.

К примеру, Европейские регуляторы призвали запретить использование искусственного интеллекта при распознавании лиц, походки, отпечатков пальцев и для обработки других биометрических данных на территории ЕС.

По их словам, технология нарушает основные права и свободы человека.

Они рекомендуют запретить системы ИИ для разделения людей на группы по признаку этнической принадлежности, пола, политических предпочтений или другим индивидуальным чертам, чтобы избежать дискриминации.

Авторы обращения также считают, что использование ИИ для распознавания эмоций крайне нежелательно и его необходимо запретить за некоторыми исключениями.

Они добавили, что полный запрет на использование распознавания лиц станет отправной точкой для сохранения свободы и создания правовой основы для ИИ, ориентированной на человека.

Напомним, что в апреле 2021 года британский активист обвинил правительственный ИИ в расизме из-за ошибок детектора лиц.

Правозащитники из 55 стран раскритиковали законопроект, который урегулирует использование технологий искусственного интеллекта в Евросоюзе.

По словам активистов, предложения Еврокомиссии лишь номинально запрещают правительствам применять биометрические системы идентификации, а прописанные в законопроекте исключения являются расплывчатыми.

Группа правозащитных организаций также хочет оказать давление на инвесторов и технологических гигантов, чтобы они прекратили финансирование и разработку систем распознавания лиц.

После прошлогодних протестов в США многие компании отказались продавать технологии полиции.

Активисты считают, что эта практика должна распространится и на другие страны мира.

С 1 июля полиция округа Колумбия перестанет использовать систему распознавания лиц NCRFRILS благодаря новому закону штата Вирджиния.

В частности, он требует, чтобы агентства получали одобрение законодательного собрания штата перед использованием такого ПО.

NCRFRILS попала под пристальное внимание после того, как The Washington Post сообщила о ее использовании в течение многих лет без публичной огласки, а также о широко освещаемых предубеждениях и сбоях систем распознавания лиц.

Технология привела к ряду неправомерных арестов, а такие города, как Портленд, Бостон и Сан-Франциско, полностью запретили эту технологию.

Группа европейских организаций по защите конфиденциальности и цифровых прав подали юридические жалобы на компанию Clearview AI властям Франции, Австрии, Греции, Италии и Великобритании.

Они утверждают, что метод компании по документированию и сбору информации нарушает европейские законы о конфиденциальности.

По их словам, сбор данных Clearview выходит за рамки того, что средний пользователь ожидает от использования таких сервисов, как Instagram, LinkedIn или YouTube.

В Clearview AI заявили, что компания никогда не заключала контрактов с клиентами из ЕС и в настоящее время ее сервисы недоступны в Европе. Однако в феврале 2021 года власти Швеции оштрафовали национальную полицию на €250 тысяч за незаконное использование Clearview AI.

Amazon — продлила запрет на использование ее технологий распознавания лиц для полиции на неопределенный срок. В компании не стали комментировать причину решения.

Незадолго до этого активисты призывали Amazon наложить бессрочный запрет на использование технологии правоохранителями. Заместитель директора Американского союза защиты гражданских свобод Натан Фрид Весслер поддержал компанию и призвал власти запретить полиции использовать подобное программное обеспечение.

Впервые Amazon запретила правоохранительным органам использовать распознавание лиц в июне 2020 года в разгар протестов против жестокого обращения полиции с цветными людьми. В компании надеялись, что в течение года Конгресс установит правила для обеспечения этичного использования технологии, однако такого закона до сих пор нет.

На международной конференции по искусственному интеллекту ICLR исследователи представили два бесплатных инструмента для защиты селфи от систем распознавания лиц.

Fawkes разработали в Чикагском университете. Он добавляет к изображениям едва заметные искажения на уровне пикселей, которые мешают алгоритмам идентифицировать людей.

Однако авторы отмечают, что их инструмент не может обмануть системы, которые уже обучены на незащищенных фотографиях.

Fawkes можно скачать для пользователей Windows и Mac.

Другой инструмент, LowKey, создали разработчики из университета Мэриленда. Он искажает изображения до такой степени, что может обмануть коммерческие ИИ-модели, такие как:

Clearview AI, AWS Rekognition, Microsoft Azure, и Face++.

LowKey доступен в качестве веб-сервиса.

Стартап DoNotPay разработал сервис для защиты фотографий от реверсивного поиска изображений в интернете.

Инструмент добавляет на фотографию пользователя слой едва заметных изменений, которые в корне искажают восприятие картинки алгоритмами распознавания лиц.

По словам разработчиков, защищенное изображение дает нулевые результаты при поиске в Google или TinEye, а также обманывает технологии распознавания лиц от Microsoft и Amazon «с вероятностью 99%».

Однако в компании сомневаются, что инструмент поможет скрыться от Clearview AI, который уже собрал многомиллиардную базу фотографий из соцсетей.

Американские правозащитники призвали правительство США прекратить использовать систему распознавания лиц Clearview AI.

В своем обращении к властям они сослались на недавний отчет, в котором выяснилось, что сотрудники из 1803 государственных органов использовали программное обеспечение без ведома своего начальства.

Помимо отсутствия надзора, правозащитники указали на расовую предвзятость алгоритмов распознавания лиц и тот факт, что Clearview AI создала свою базу данных, собирая фотографии и видео из Facebook, Twitter и YouTube.

Касперский: искусственный интеллект, равный человеческому, появится через тысячу лет.

Современные нейросети способны решать только примитивные задачи, заявил генеральный директор «Лаборатории Касперского»

Искусственному интеллекту (ИИ) понадобится как минимум тысяча лет, чтобы достичь уровня человеческого, сообщил генеральный директор «Лаборатории Касперского» Евгений Касперский во вторник на пленарной дискуссии международного IT-форума в Ханты-Мансийске.

«До биологического интеллекта искусственному еще лет тысяча. То, что сейчас называют ИИ — это, технически говоря, система машинного обучения, нейросети, но они способны решать только гораздо более примитивные задачи», — отметил Каперский.

В качестве примера он привел распознавание лиц, технологию, которую многие сейчас называют искусственным интеллектом.

«Но искусственный интеллект должен распознавать не только человеческие лица, но и собак и лошадей, а вот machine learning (машинное обучение — прим.) не умеет таких задач. Настоящий интеллект отличается от искусственного тем, что, во-первых, способен решать задачи, на которые не запрограммирован, а во-вторых, у него есть мотивация. У программных алгоритмов пока нет мотивации. Поэтому это не интеллект, это machine learning, нейросети».

По его словам, в компании используют искусственный интеллект для обнаружения новых вредоносных программ, которые ежедневно насчитывают 300-400 тыс. файлов.

«И киберпреступники становятся более профессиональными, они используют машинное обучение для того, чтобы более эффективно «ползать по сетям»,и обманывать другие типы и виды того, что сегодня принято называть ИИ» — добавил Касперский.

По этой ссылке вы сможете ознакомиться с полной и подробной статьёй от Лаборатории Касперского.

Для начала, всей этой информации будет достаточно для вас друзья, чтоб определить для себя, полезен нам Искуственный Интеллект, или-же он как и все новейшие технологии, в зависимости в какие руки попадут разработки того или иного проекта на основе ИИ.

И мы конечно-же продолжим наблюдать за развитием этой технологии в нашей повседневной жизни.